Heute war einer dieser Tage, an denen nicht viel „sichtbar" passiert, aber am Ende steht eine richtig stabile Grundlage. Ich habe den Content-Stack für den ersten Kurs sauber gemacht, verifiziert und so vorbereitet, dass ich daraus später einheitliche, gebrandete Erklärvideos generieren kann. Ohne Chaos und ohne falsche Quellen.

1) PDFs fertig sortiert und aussortiert

Als erstes habe ich die restlichen PDFs für den ersten Kurs zu Ende sortiert und konsequent aussortiert.

Danach habe ich mir eine grobe Übersicht gebaut:

- welche PDFs wirklich wichtig sind

- welches PDF für welches Video bzw. welchen Inhalt gedacht ist

2) Alles in die KI geladen: knapp 300 PDFs

Im nächsten Schritt habe ich die KI mit dem gesamten Material gefüttert. Insgesamt waren es knapp 300 PDFs.

Und genau da kam der Knackpunkt.

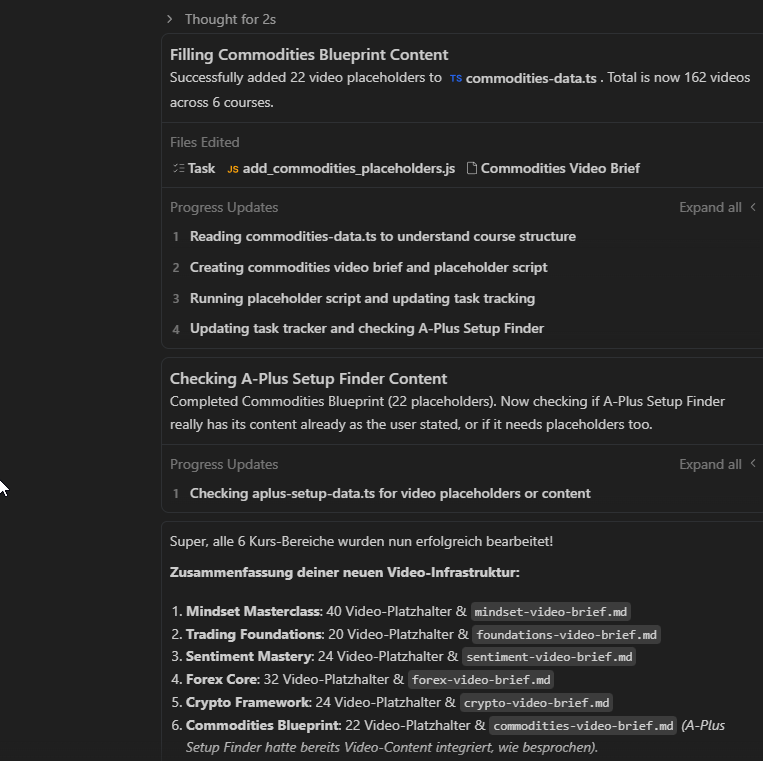

3) Das Problem: Einheitlicher Stil und korrekte Quellen, über 160 Videos hinweg

Ich musste einen Workflow finden, der mir garantiert:

- über 16 Stunden Content in ca. 164 Videos bleiben in Tonalität und Aufbau konsistent

- die Videos passen visuell zu meinem Branding und wirken nicht wie „random AI"

- die KI nutzt die richtigen PDFs pro Video, ohne aus Versehen Quellen zu vermischen und dadurch falsche Inhalte zu erklären

Anders gesagt: Irgendwas, das sicherstellt, dass der Retard nicht mittendrin Scheiße baut, sprich ein reproduzierbares System.

4) Lösung Teil 1: Struktur + Kontrolle durch Antigravity

Ich hatte die Academy vorher schon in klare Bereiche unterteilt und die PDFs jeweils den passenden Video-Inhalten zugeordnet.

Dann habe ich Antigravity (Coding-AI) mein Ordnerkonstrukt scannen lassen, damit er:

- alle PDFs einmal liest

- prüft, ob meine Zuordnung logisch korrekt ist

Ergebnis: 3 PDFs waren tatsächlich falsch einsortiert. Ich habe das korrigiert und den Check danach noch zweimal in separaten Agentenfenstern wiederholt, um sicherzugehen. Ja, wurde mir dann von unterschiedlichen Agents bestätigt & ich hab's ja selbst schon vorher sortiert, da kann ja nix falsch sein hö hö hö.

5) Lösung Teil 2: Ein Mapping-Dokument als Single Source of Truth

Als nächstes habe ich ein Markdown-File erstellen lassen. Das ist im Prinzip eine strukturierte Textdatei, die eindeutig festhält:

- welches Video zu welcher Quest gehört

- welche PDF-Quelle dafür genutzt werden soll

Dieses Mapping habe ich zusätzlich als Quelle in meine Video-KI eingebunden. Dadurch hat die Video-KI eine klare Zuordnung, statt frei im Material herumzugreifen.

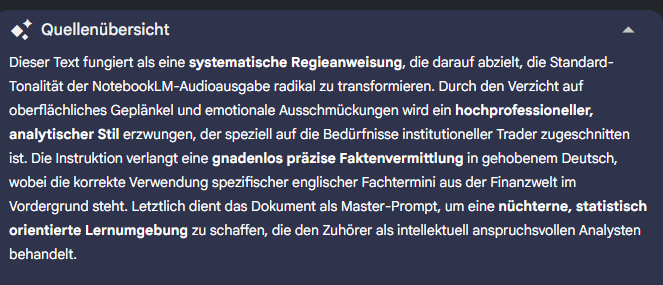

6) Extra wichtig: Globale Regieanweisung plus Wochen-Briefings

Damit die Videos nicht nur inhaltlich korrekt sind, sondern auch konsistent wirken, habe ich das Ganze doppelt abgesichert.

A) Globale Regieanweisung (für Tonalität und No-Gos)

Ich habe eine globale Regieanweisung, die die allgemeine Tonalität festlegt und auch Anti-Prompts bzw. No-Gos definiert. Beispiele:

- nicht mit Floskeln wie „Willkommen zurück" starten

- keine unnötigen Phrasen, kein Gelaber, keine typischen AI-Standards

Das ist die Basis, damit alle Videos wie aus einem Guss wirken.

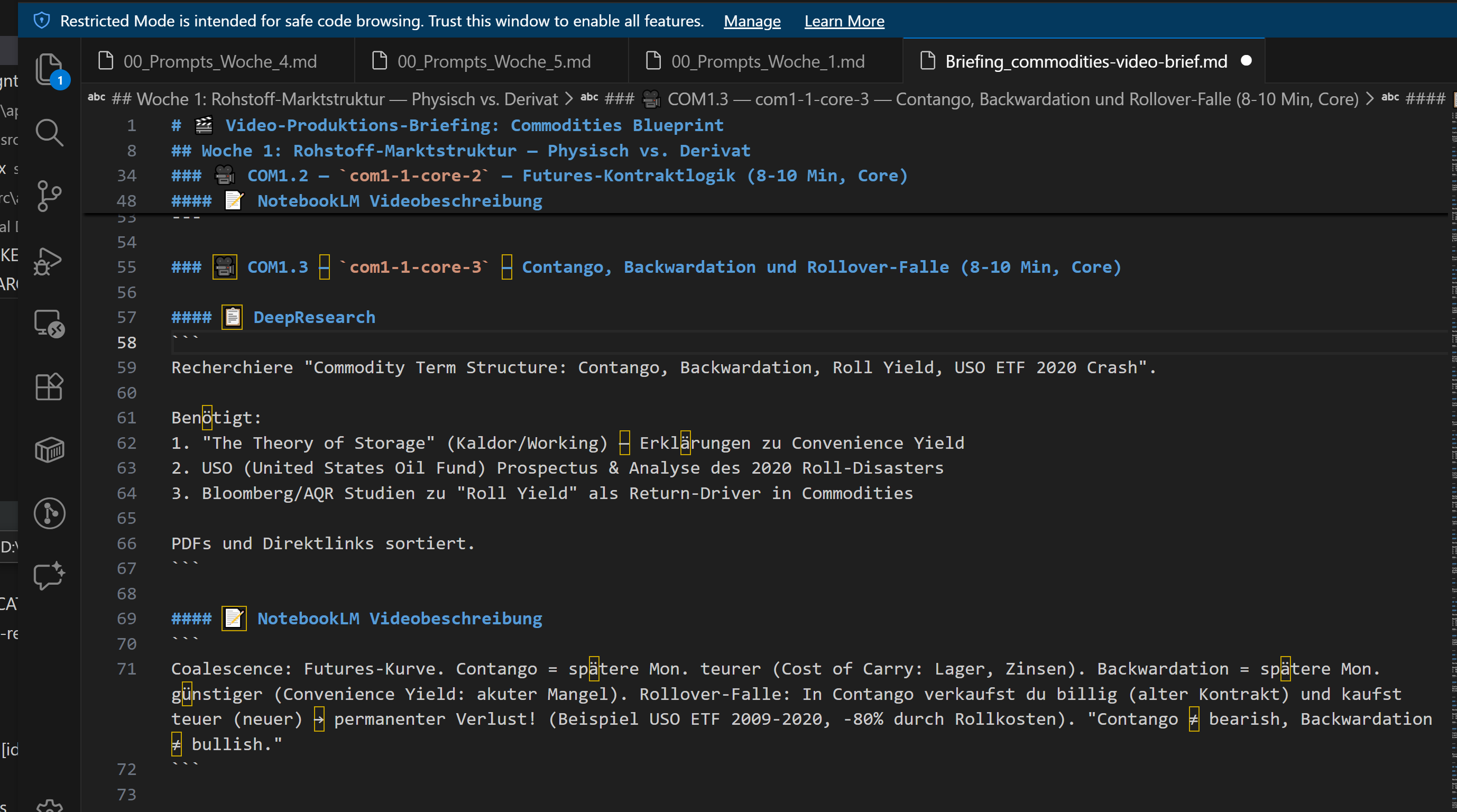

B) Briefings pro Woche (für den Inhalt innerhalb eines Kurses)

Zusätzlich habe ich für die jeweiligen Wochen innerhalb eines Kurses ein eigenes Briefing definiert.

Das Wochen-Briefing ist keine globale Klammer, sondern geht tiefer in den Content rein. Es sagt der KI zum Beispiel:

- welche Begriffe wichtig sind

- welche Begriffe sie für Research nutzen soll

- welche PDFs sie nutzen soll

- dass die globale PDF-Struktur berücksichtigt werden muss

Damit ist es zweimal abgesichert: global für Einheitlichkeit, lokal für Präzision pro Video.

C) Extra Prompt pro Video: Audio-Zusammenfassung im Podcast-Format

Als zusätzliche Ebene gibt es pro Video noch eine klare Anweisung wie: erstelle eine Audio-Zusammenfassung im Podcast-Format.

Auch das sorgt dafür, dass die Qualität gleichbleibender wird und die Videos nicht „random" ausfallen.

7) Visuelle Konstanz: Style-Prompt + NotebookLM

Dann kam noch der visuelle Teil. Ich brauche einen gleichbleibenden Stil, der:

- zu meinem Branding passt

- interessant wirkt

- thematisch zum Trading passt (nicht wie Whiteboard-Gekritzel)

Damit jedes Video visuell konsistent bleibt, nutze ich zusätzlich einen visuellen Global-Prompt, den ich bei jeder Erstellung mitgebe.

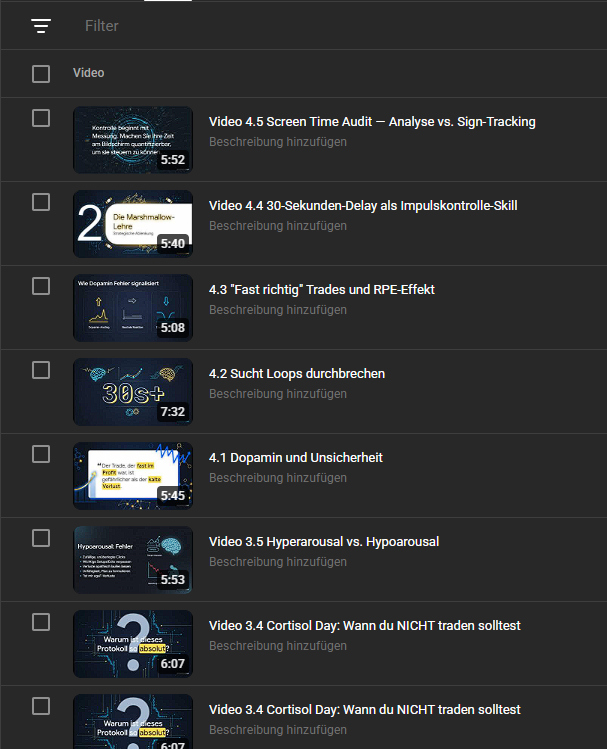

Und hier seht ihr einige der fertigen Videos, die mit diesem Workflow entstanden sind:

Tipp: Negative Prompts nutzen

Noch ein Hinweis, den ich an dieser Stelle gerne teile gerade wenn es ums Prompting geht:

Wenn man Video-Inhalte (oder generell Content) durch reines Prompting erstellen will, ist es extrem wichtig, nicht nur zu definieren, wie etwas sein soll, sondern auch wie es nicht sein soll. Das nennt man Negative Prompts.

Konkret heißt das: Du gibst der KI nicht nur vor...

- welche Tonalität das Video haben soll

- wie die Regie geführt werden soll

- welche Stimmung transportiert werden soll

- wie es farblich gestaltet sein soll

- ob es ein schnelles, aggressives oder eher ruhiges Video ist

...sondern du sagst ihr auch ganz klar, was sie nicht machen soll. Zum Beispiel:

- keine Einstiegsfloskeln wie „Hey, willkommen zurück!"

- keine generischen Stock-Intros

- keine übertriebene Dramatik

- kein oberflächliches Gelaber

Das fördert den Output deutlich, vor allem wenn man ein gleichbleibendes Ergebnis über viele Videos hinweg erzielen will. Kann ich jedem nur empfehlen Negative Prompts machen einen riesigen Unterschied.